مدلهای زبان بزرگ مانند GPT-4 «جعبههای سیاه» قدرتمند اما غیرشفاف هستند. تکنیکهای جدید برای هوش مصنوعی قابل توضیح و طراحی شفاف میتواند به باز کردن مزایای آنها در حین حسابرسی ریسکها کمک کند.

مدلهای زبان بزرگ (LLM) مانند GPT-3 قابلیتهای زبان طبیعی چشمگیری را نشان دادهاند، اما عملکرد درونی آنها به خوبی درک نشده است. این ماهیت “جعبه سیاه” باعث می شود LLM ها در هنگام استقرار در برنامه های کاربردی حساس دنیای واقعی مشکل ساز شوند.

مشکل جعبه سیاه LLM چیست؟

مدلهای یادگیری زبان (LLM) ابزارهای قدرتمندی هستند که برای پردازش و تجزیه و تحلیل حجم وسیعی از متن به یادگیری عمیق متکی هستند. امروزه آنها مغز همه چیز از چت ربات خدمات مشتری گرفته تا ابزارهای تحقیقاتی پیشرفته هستند.

با این حال، علیرغم کاربردشان، آنها به عنوان «جعبههای سیاه» عمل میکنند و منطق پشت تصمیمهایشان را پنهان میکنند. این کدورت فقط یک معمای فناوری نیست. این یک مشکل با مفاهیم ایمنی و اخلاقی است. اگر نمی دانیم این سیستم ها چگونه به نتیجه می رسند، چگونه از آنها به طور موثر استفاده کنیم و مهمتر از آن می توانیم در تصمیم گیری های حیاتی مانند تشخیص های پزشکی یا ارزیابی ریسک مالی به آنها اعتماد کنیم؟

مقیاس و پیچیدگی LLM

LLM ها حاوی تعداد زیادی پارامتر هستند – GPT-3 دارای 175 میلیارد پارامتر است، در حالی که مدل های جدیدتر می توانند تریلیون ها پارامتر داشته باشند. این مقیاس عظیم، درک کامل منطق درونی آنها را تقریباً غیرممکن می کند. هر پارامتر به روش های پیچیده ای با بسیاری دیگر در معماری شبکه عصبی LLM ها تعامل دارد. این درهم تنیدگی به این معنی است که رفتار کلی سیستم را نمی توان به راحتی به قوانین قابل تشخیص تقلیل داد.

پیچیدگی با افزایش مقیاس ترکیب می شود. با تریلیونها پارامتر، LLMها قابلیتهای نوظهوری را نشان میدهند – تواناییهایی که از سیستم بهعنوان یک کل ناشی میشوند که با بررسی اجزای جداگانه قابل پیشبینی نیستند. به عنوان مثال، قابلیتی مانند استدلال عقل سلیم از قرار گرفتن در معرض مجموعه داده های عظیم پدید می آید، نه کدگذاری سخت قوانین.

مقیاس و پیچیدگی LLM ها منجر به مشکلات ذاتی در تفسیر نحوه پردازش زبان یا رسیدن به نتیجه می شود. تصمیم گیری آنها حتی برای سازندگان خود مبهم به نظر می رسد. این مانع از تشخیص رفتارهای ناخواسته یا سوگیری هایی می شود که مدل ها نشان می دهند. کاهش مقیاس می تواند تفسیرپذیری را بهبود بخشد، اما به احتمال زیاد به بهای قابلیت. مقیاس خود رفتارهای غیرممکن را با مدلهای کوچکتر ممکن میسازد. بنابراین مبادلات ذاتی بین مقیاس، قابلیت و قابلیت تفسیر وجود دارد.

عدم شفافیت توسط توسعه دهندگان LLM

اکثر LLM های بزرگ توسط شرکت های فناوری بزرگ مانند گوگل، متا و OpenAI توسعه داده می شوند. این مدلها سیستمهای اختصاصی هستند که جزئیات کامل آنها به صورت عمومی فاش نشده است. این شرکت ها LLM های خود را به عنوان اسرار تجاری تلقی می کنند و تنها اطلاعات محدودی در مورد معماری مدل، داده های آموزشی و فرآیندهای تصمیم گیری فاش می کنند.

این عدم شفافیت از ممیزی مستقل سیستم ها برای سوگیری ها، نقص ها یا مسائل اخلاقی جلوگیری می کند. بدون شفافیت، بررسی اینکه آیا از دادههای ناامن در آموزش استفاده میشود یا اینکه مدلها سوگیریهای ناعادلانه دارند، غیرممکن است. عموم مردم باید به سادگی به تضمین های سازندگان اعتماد کنند.

با این حال، مشخص شده است که حتی سازندگان نیز به طور کامل نمیدانند مدلهایشان چگونه کار میکنند. آنها ممکن است معماری کلی را درک کنند، اما نمی توانند رفتارهای نوظهور پیچیده ای را که از مقیاس های وسیع ناشی می شوند، توضیح دهند. به عنوان مثال، OpenAI اعتراف کرد که ابزار آشکارساز متن هوش مصنوعی آنها هفتهها پس از انتشار آن به طور قابل اعتماد کار نمیکند. اگر خود توسعه دهندگان نتوانند منطق LLM خود را توضیح دهند، حسابرسی واقعی آنها حتی چالش برانگیزتر می شود.

فقدان شفافیت امکان استقرار سیستم های بالقوه مشکل ساز با مسئولیت پذیری محدود را فراهم می کند. همچنین از شناسایی و رسیدگی به مسائل مربوط به LLM ها جلوگیری می کند. تقاضا برای شرکتهای فناوری برای باز کردن سیستمهای هوش مصنوعی خود برای بررسی در حال افزایش است. اما انگیزه ها برای حفظ رازداری و مزایای اختصاصی همچنان قوی هستند.

پیامدهای مشکل جعبه سیاه LLM

فقدان تفسیرپذیری در LLM ها در صورتی که مشکل جعبه سیاه به طور معناداری مورد توجه قرار نگیرد، خطرات قابل توجهی ایجاد می کند. برخی از پیامدهای نامطلوب بالقوه عبارتند از:

تصمیمات ناقص

فقدان شفافیت در تصمیم گیری LLM به این معنی است که هرگونه سوگیری، خطا یا نقص در قضاوت آنها می تواند کشف نشده و بررسی نشود. بدون قابل مشاهده بودن استدلال آنها، توانایی محدودی برای شناسایی مشکلات یا ناسازگاری ها در نحوه تجزیه و تحلیل اطلاعات و نتیجه گیری LLMها وجود دارد.

این امر خطرات قابل توجهی را هنگام استقرار LLM در برنامه های حساس دنیای واقعی مانند مراقبت های بهداشتی، مالی و عدالت کیفری ایجاد می کند. به عنوان جعبه سیاه، تصمیمات آنها از نظر صحت و اخلاقی بودن قابل بررسی نیست. انتخابهای نادرست، نامناسب یا غیراخلاقی میتواند بدون آگاهی از آن قبل از تأثیرات منفی منجر شود.

برای مثال، یک LLM پزشکی میتواند توصیههای تشخیصی را بر اساس اطلاعات قدیمی یا سوگیریهای کنترل نشده که در دادههای آموزشی تعبیه شده است، ارائه دهد. بدون شفافیت، نمیتوان استدلال آن را از نظر پزشکی صحیح در مقابل تبعیضآمیز تأیید کرد. به طور مشابه، اگر اشتباهات در منطق قضاوت به عنوان یک سیستم جعبه سیاه اصلاح نشود، یک LLM استخدام کننده ممکن است نامزدهای واجد شرایط را به دلیل جنسیت تخفیف دهد.

آزمایش دنیای واقعی به تنهایی برای تشخیص تمام عیوب بدون دید داخلی کافی نیست. حل فعال مشکل جعبه سیاه برای جلوگیری از انتشار LLMهایی که تعصب و استدلال نادرست را که منجر به آسیبهای واقعی میشود، کدگذاری میکنند، حیاتی است. توضیحپذیری کلیدی برای حسابرسی یکپارچگی تصمیمگیری LLM قبل از استقرار با ریسک بالا است.

مشکل در تشخیص خطاها

هنگامی که LLM ها پیش بینی های نادرست یا اشتباه می کنند، عدم شفافیت در تصمیم گیری آنها موانعی را برای شناسایی علت اصلی ایجاد می کند. بدون مشاهده منطق و پردازش مدل، مهندسان توانایی محدودی برای تشخیص اینکه کجا و چرا سیستمها از کار میافتند، دارند.

مشخص کردن اینکه آیا داده های آموزشی بد، نقص در معماری مدل یا عوامل دیگر مسئول خطاها هستند یا خیر، تبدیل به یک معمای جعبه سیاه می شود. LLM ها ممکن است سوگیری های مضر را بازتولید کنند یا نتیجه گیری های غیرمنطقی داشته باشند که تا پس از استقرار ناشناخته می مانند. دلایل اصلی این شکست ها را نمی توان بدون رمزگشایی استدلال مدل تعیین کرد.

به عنوان مثال، یک الگوریتم استخدام ممکن است به طور ناخواسته بین کاندیداهای خاصی تبعیض قائل شود. اما ممیزی کد سیستم بدون درک اینکه چگونه LLM در نهایت ویژگیهای مختلف را وزن میکند و قضاوت میکند، چیز کمی را نشان میدهد. بدون تشخیص منبع مشکلات، نمی توان آنها را به طور قابل اعتماد برطرف کرد یا از عود مجدد آنها جلوگیری کرد.

دشواری کاوش در LLM ها همچنین مانع از اعتبارسنجی این می شود که سیستم ها همانطور که قبل از انتشار در دنیای واقعی در نظر گرفته شده کار می کنند. روشهای تست دقیقتری برای تحریک موارد لبه و تشخیص پاسخها بدون دید داخلی مورد نیاز است. حل مشکل جعبه سیاه کلید فعال کردن تجزیه و تحلیل و تصحیح خطا است.

سازگاری محدود

کدورت LLM ها همچنین توانایی آنها را برای سازگاری با وظایف و زمینه های مختلف محدود می کند. کاربران و توسعه دهندگان دید محدودی به اجزای مدل و وزن آن برای انجام تنظیمات هدفمند بر اساس برنامه ها دارند.

به عنوان مثال، استخدام LLM ممکن است در ارزیابی نامزدها برای یک نقش مهندسی بی اثر باشد، زیرا نمی تواند اعتبارات دانشگاهی را در مقابل مهارت های نشان داده شده از بین ببرد. بدون شفافیت مدل، تنظیم مجدد مؤلفه ها برای بهبود سازگاری در دامنه ها دشوار است.

به طور مشابه، یک LLM پزشکی ممکن است در تشخیص بیماری نادر دچار مشکل شود، زیرا عدم تعادل داده ها در آموزش این موارد لبه را پنهان کرده است. اما ماهیت جعبه سیاه کالیبره کردن مجدد وزن و استدلال تشخیصی مدل برای کارهای تخصصی را چالش برانگیز می کند.

LLM ها اغلب هنگام اعمال مشکلات جدید شکست می خورند یا ضعیف عمل می کنند زیرا نمی توان آنها را بدون دیده شدن در عملکرد درونی خود تنظیم کرد. کاربران نمی توانند به راحتی تشخیص دهند که چگونه سیستم ها را برای نیازهای خاص خود تغییر دهند. حل مشکل جعبه سیاه، سازگاری برتر را در موقعیتهای مختلف دنیای واقعی و موارد استفاده امکانپذیر میسازد.

نگرانی در مورد تعصب و شکاف دانش

در حالی که LLM ها ممکن است به داده های آموزشی عظیم دسترسی داشته باشند، نحوه پردازش و استفاده از این اطلاعات به معماری و الگوریتم مدل آنها بستگی دارد. دانش آنها ثابت است و در زمان آموزش قفل شده است. اما استدلال آنها می تواند سوگیری های پویا و غیرقابل پیش بینی را بر اساس آن عوامل معماری نشان دهد.

به عنوان مثال، یک LLM پزشکی میتواند سوگیریهای جمعیتی را نشان دهد اگر بر روی مجموعه دادههای حاوی نمایش نامتعادل آموزش داده شود. اما ممیزی محدودیت های دانش آن مستلزم فراتر رفتن از خود داده های آموزشی برای بررسی نحوه سنجیدن آن توسط مدل است.

به طور مشابه، دانش یک LLM در مورد موضوعات خاص ممکن است ناقص باشد، اگر پیش آموزش نتواند آن حوزه ها را پوشش دهد. اما ممکن است به نادرستی اعتماد بیش از حد در تولید متن گمانه زنی در مورد آن موضوعات بدون بررسی به دست آورد. این حدس و گمان خطر ایجاد توهمات واقعی خارج از دانش واقعی خود را افزایش می دهد.

بنابراین، در حالی که LLM ها حاوی دانش گسترده ای هستند، نحوه به کارگیری آن ها به مکانیک پردازش غیر شفاف متکی است. صرف افزودن دادههای آموزشی بیشتر لزوماً شکافها یا سوگیریهایی را که از منطق سیستم جعبه سیاه پدید میآیند، برطرف نمیکند. خود استدلال مدل، نه فقط دانش مدل، به شفافیت برای ارزیابی معنادار LLMها نیاز دارد.

حل مشکل جعبه سیاه بینش کامل تری را در مورد اینکه چه زمانی LLM ها به طور قابل اعتماد در مقابل حوزه های دانش هسته ای خارج از حدس و گمان عمل می کنند، ارائه می دهد. اطلاعات آنها فقط به اندازه پردازنده های آنها مفید است.

مسئولیت قانونی

ماهیت جعبه سیاه LLM ها همچنین مسئولیت قانونی نامشخصی را در صورت آسیب رساندن به سیستم ها ایجاد می کند. اگر یک LLM تصمیم یا توصیهای را اتخاذ کند که منجر به تأثیرات مضر در دنیای واقعی شود، کدورت آن تشخیص پاسخگویی را دشوار میکند.

بدون شفافیت در استدلال مدل و مدیریت دادهها، شرکتهایی که LLM را به کار میگیرند میتوانند با مبهم کردن نحوه عملکرد سیستمهای خود از مسئولیت فرار کنند. اثبات سوء استفاده یا سهل انگاری زمانی چالش برانگیز می شود که فرآیندهای داخلی غیرقابل تشخیص باشند.

به عنوان مثال، اگر یک LLM پزشکی توصیه های درمانی نادرستی را ارائه دهد که منجر به آسیب به بیمار می شود، اگر LLM با سهل انگاری یا خلاف مقررات عمل کرده باشد، منطق مبهم مانع از بررسی می شود. کسانی که تحت تأثیر قرار گرفته اند ممکن است بدون قابلیت توضیح مدل واضح تر، مراجع قانونی محدودی داشته باشند.

این منطقه خاکستری قانونی خطرات را برای شرکت هایی که LLM ها را در مناطق حساسی مانند سلامت، امور مالی و امنیت به کار می گیرند، افزایش می دهد. آنها ممکن است با شکایت، محدودیت یا حتی ممنوعیت مواجه شوند، اگر نتوانند تصمیم گیری LLM خود را توضیح دهند و سخت کوشی نشان دهند. حل مشکل جعبه سیاه برای ایجاد چارچوبهای پاسخگویی و حکمرانی مناسب از طریق شفافیت مدل بسیار مهم است.

کاهش قابلیت اعتماد

کدورت جعبه سیاه LLM ها، تایید خارجی را که آیا آنها منصفانه و اخلاقی عمل می کنند، به ویژه در زمینه های حساس، غیرممکن می کند. برای برنامههایی مانند مراقبتهای بهداشتی، مالی و استخدام، عدم شفافیت مانع از تشخیص این موضوع میشود که آیا سیستمها دارای سوگیریهای مشکلساز هستند یا بر اساس معیارهای ناعادلانه تصمیم میگیرند.

بدون مشاهده استدلال مدل داخلی، کاربران توانایی محدودی برای ممیزی الگوریتم هایی دارند که می تواند عمیقاً بر زندگی افراد تأثیر بگذارد. تأیید معیارهایی مانند بی طرفی جنسیتی و انصاف نژادی هنگام بررسی ورودی ها و خروجی ها به تنهایی مانع می شود. بررسی LLM ها به عنوان بی طرفانه مستلزم درک فرآیندهای تصمیم گیری آنها است.

این کاهش اعتماد، چالشهایی را برای ادغام LLMها در عملکردها با پیامدهای قابل توجه در دنیای واقعی ایجاد میکند. اگر قضاوتهای آنها از نظر یکپارچگی قابل بررسی نباشد، احتمالاً تنظیمکنندهها اجازه استقرار گسترده LLMها را در حوزههای پرمخاطب نمیدهند. روش هایی برای فعال کردن ممیزی های شخص ثالث از سوگیری ها و عدالت در LLM ها برای ایجاد اطمینان در کاربرد آنها مورد نیاز است.

حل مشکل جعبه سیاه برای فعال کردن پاسخگویی در مورد اخلاق و انصاف ضروری است. کاربران نمی توانند به طور منطقی به LLM هایی که به عنوان سیستم های جعبه سیاه عمل می کنند اعتماد کنند. شفافیت و توضیحپذیری برای باز کردن قفل برنامههای مفید و مسئولیتپذیر بسیار مهم است.

تجارب کاربر تنزل یافته

عدم شفافیت در تصمیم گیری LLM همچنین کیفیت تجارب و تعاملات کاربر را کاهش می دهد. وقتی کاربران درک نمی کنند که چگونه یک LLM در زیر هود کار می کند، نمی توانند اعلان ها و ورودی ها را به طور موثرتری برای رسیدن به خروجی های دلخواه ایجاد کنند.

به عنوان مثال، یک LLM قانونی ممکن است اگر با اصطلاحات نادقیق پرس و جو شود، بینش مفیدی را ارائه ندهد. اما کاربران نمیتوانند ورودیها را بدون آگاهی از نحوه تجزیه زبان توسط مدل اصلاح کنند. آنها حدس می زنند که چگونه آن را از طریق آزمون و خطا بیاورند.

به طور مشابه، اگر کاربران نتوانند پردازش آن را با وزن دادن به کلمات کلیدی یا مضامین در درخواست ها هدایت کنند، یک LLM نوشتن خلاق ممکن است متنی را تولید کند که تداوم مناسبی ندارد. بدون مشاهده منطق عملیاتی، کاربران نمی توانند تعاملات را برای خروجی های منسجم شکل دهند.

LLMهای غیرشفاف، کاربران را مجبور میکنند تا سیستمها را بهعنوان اوراکلهایی در نظر بگیرند که نتایج ضربه یا از دست دادن را تولید میکنند. اما شفافیت مدل می تواند کاربران را قادر سازد تا با آنها تعامل موثرتری داشته باشند. حل مشکل جعبه سیاه به جای تصادفی بودن، عاملیت کاربران را در استفاده از LLM با پتانسیل کامل آنها در بین برنامه ها فراهم می کند.

خطر سوء استفاده از داده های خصوصی

LLM ها به حجم عظیمی از داده های آموزشی، از جمله مجموعه داده های حاوی اطلاعات شخصی خصوصی نیاز دارند. با این حال، کدورت جعبه سیاه، تأیید نحوه استفاده داخلی از این داده های حساس را غیرممکن می کند. بدون شفافیت در فرآیندهای رسیدگی به داده ها، خطرات سوء استفاده یا سوء استفاده از اطلاعات شخصی نادرست وجود دارد.

به عنوان مثال، LLM های پزشکی که بر روی سوابق سلامت بیمار آموزش دیده اند، به طور بالقوه می توانند آن داده ها را افشا کنند یا بر اساس عواملی مانند جمعیت شناسی به جای تجزیه و تحلیل صحیح پزشکی، در مورد افراد تصمیم گیری کنند. اما ممیزی نحوه استفاده LLM از داده های آموزشی حساس توسط مشکل جعبه سیاه مهار می شود.

به طور مشابه، LLMهایی که در استخدام، وام دادن یا مسکن مستقر می شوند، می توانند از عواملی مانند نژاد، جنسیت یا قومیت سوء استفاده کنند، اگر سوگیری های ناعادلانه در طول فرآیندهای آموزشی غیرشفاف تعبیه شود. اگر اطلاعات شخصی افراد بدون توضیح مورد سوء استفاده قرار گیرد، امکان استفاده کمی وجود دارد.

الزاماتی مانند پوشاندن داده ها، دسترسی مدل انتخابی به فیلدهای داده، و مکانیسم های حسابرسی داخلی احتمالاً برای کاهش خطرات سوء استفاده از داده های خصوصی مورد نیاز است. اما زمانی که فرآیندهای LLM به اندازه کافی قابل تفسیر نباشند، اجرای پادمان ها همچنان یک چالش باقی می ماند. حل مشکل جعبه سیاه کلید تامین امنیت داده های شخصی است که برای توسعه سیستم های هوش مصنوعی قدرتمند استفاده می شود.

استفاده های غیر اخلاقی

کدورت LLM خطراتی را برای فعال کردن برنامه های غیراخلاقی بدون پاسخگویی ایجاد می کند. به عنوان مثال، در صورتی که فرآیندهای داخلی آنها شفاف نباشد، استفاده از LLM برای نظارت انبوه می تواند حقوق حریم خصوصی را نقض کند. LLM ها می توانند به طور مخفیانه داده ها و ارتباطات خصوصی را بدون توضیح فعالیت های خود تجزیه و تحلیل کنند.

علاوه بر این، فقدان شفافیت توسعه سیستم هایی را با هدف ترغیب یا نفوذ بالقوه غیراخلاقی تسهیل می کند. LLM های دستکاری می توانند به گونه ای طراحی شوند که به طور مخفیانه تفکر را به روش های نامطلوب تحت تأثیر قرار دهند که در صورت پنهان ماندن عملکرد درونی آنها، از شناسایی فرار می کنند.

عدم نظارت بر تصمیم گیری LLM پوششی را برای سوء استفاده در سیستم هایی که بر زندگی انسان ها تأثیر می گذارد، فراهم می کند. شرکتها یا دولتها میتوانند ادعا کنند که سیستمها از نظر اخلاقی عمل میکنند و در عین حال فرآیندهایی را که حقوق و ارزشها را نقض میکنند، مبهم میکنند.

بدون حل مشکل جعبه سیاه، ابزارهای فنی محدودی برای جلوگیری از سوء استفاده از LLMهایی که هنجارها را نقض می کنند وجود دارد. اجرای اخلاقی مستلزم شفافیت برای تأیید همسویی با اصول انسانی در کاربردهای تأثیرگذار است. LLM های غیر شفاف آسیب های کنترل نشده را فعال می کنند.

این عواقب بیشتر می تواند منجر به موارد زیر شود:

- از دست دادن اعتماد عمومی: استفاده گسترده از مدلهای جعبه سیاه غیرقابل درک میتواند اعتماد عمومی و پذیرش سیستمهای هوش مصنوعی را تضعیف کند.

- نوآوری خفه شده: مقامات ممکن است کاربردهای LLM را که آنها را غیرقابل اعتماد می دانند محدود کنند و جامعه را از مزایای بالقوه محروم کنند.

- نقض حریم خصوصی: فقدان حفاظت در مورد نحوه استفاده از داده های خصوصی در طول آموزش می تواند منجر به بهره برداری بدون نیاز به توضیح شود.

- نظارت محدود: فقدان شفافیت مانع از حاکمیت و نظارت مؤثر برای اطمینان از استقرار اخلاقی و ایمن LLM می شود.

حل مشکل جعبه سیاه برای باز کردن پتانسیل کامل LLM ها بسیار مهم است. اگر تفکر آنها مبهم بماند، خطرات احتمالاً بیشتر از مزایای بسیاری از برنامه ها خواهد بود. افزایش قابلیت توضیح کلیدی برای جلوگیری از پیامدهای نامطلوب است.

راه حل های بالقوه برای مشکل جعبه سیاه LLM

در حالی که مشکل جعبه سیاه LLM چالش های بزرگی را ایجاد می کند، تکنیک های قابل اجرا برای افزایش شفافیت و توضیح مدل در حال ظهور هستند. با بازنگری در معماری مدل، فرآیندهای آموزشی و روش های استنتاج، LLM ها می توانند بدون از بین بردن قابلیت ها قابل تفسیر شوند.

رویکردهای امیدوارکننده شامل شبکههای عصبی جعبه شیشهای، ادغام نمودارهای دانش و تکنیکهای هوش مصنوعی قابل توضیح است. اگرچه موانع دشواری باقی مانده است، اما پیشرفت مداوم به سمت راه حل های قابل قبول در حال انجام است. مسیر رو به جلو در همکاری بین رشتهای نهفته است تا LLMهای شفاف و در عین حال قدرتمندی که برای استقرار گسترده مناسب هستند، ایجاد شود. با تحقیقات دقیق و نوآوری مسئولانه، می توان جعبه سیاه را باز کرد.

معماری “جعبه شیشه ای”.

یک رویکرد برای کاهش مشکل جعبه سیاه، توسعه ساختارهای مدل شیشه ای شفاف تر و فرآیندهای آموزشی است. این شامل طراحی LLM ها برای ایجاد دید بهتر در بازنمایی داده های داخلی و استدلال آنها است.

تکنیکهایی مانند مکانیسمهای توجه و ساختارهای مدل مدولار میتوانند به چگونگی جریان اطلاعات در لایههای شبکه عصبی کمک کنند. ابزارهای تجسم می توانند نشان دهند که چگونه ورودی های مختلف بخش های خاصی از مدل را فعال می کنند.

علاوه بر این، تکنیکهای آموزشی تقویتشده مانند یادگیری مخالف و مثالهای متضاد میتوانند مرزهای تصمیم مدل را بررسی کنند. تجزیه و تحلیل زمانی که LLM در این نمونههای آموزشی خاص موفق میشود یا شکست میخورد، بینشهایی را در مورد فرآیند استدلال آن ارائه میکند.

ثبت حالت های فعال سازی گام به گام در لایه ها در طول استنتاج همچنین می تواند چگونگی انجام محاسبات منطقی مدل را روشن کند. این می تواند سیگنال های مورد استفاده برای کارهای خاص را شناسایی کند.

به طور کلی، ساخت LLM با اجزای قابل توضیح تر و رژیم های آموزشی می تواند شفافیت مدل را بهبود بخشد. کاربران می توانند رفتارهای سیستم را بهتر بررسی کنند، نقص ها را تشخیص دهند و بازخورد اصلاحی را برای مدل های جعبه شیشه ای ارائه دهند. این باعث می شود LLM ها برای عملکرد منصفانه تر به طور مداوم مورد بررسی و پالایش قرار گیرند.

نمودارهای دانش

گنجاندن نمودارهای دانش ساختاریافته در LLMها روش امیدوارکننده دیگری برای کاهش مشکل جعبه سیاه است. نمودارهای دانش حاوی اطلاعات واقعی به شکل شبکه ای و معنایی است که می تواند استدلال مدل را به روشی قابل توضیح تقویت کند.

رمزگذاری دانش انتخابشده در LLM میتواند اتکا به الگوهای آماری صرفاً از دادههای آموزشی را که به کدورت کمک میکنند، کاهش دهد. به عنوان مثال، LLM های پزشکی می توانند از نمودارهای دانش داده های زیست پزشکی هستی شناسی به عنوان یک لایه شفاف اضافی از استدلال ساختار یافته در مورد بیماری ها، علائم، درمان ها و غیره استفاده کنند.

در طول استنتاج، LLM ها می توانند به نمودارهای دانش ارجاع دهند تا حقایق و روابط مربوطه را برای اطلاع رسانی و توضیح نتیجه گیری بازیابی کنند. این مکمل تشخیص الگوی ذاتی شبکه های عصبی با یک چارچوب دانش پایه است.

LLM هایی که به طور مشترک با نمودارهای دانش آموزش دیده اند، ممکن است استدلال واقعی و اعتبار خود را برای پیش بینی های داده شده بهتر بیان کنند. این می تواند از طریق ممیزی محتوای نمودار دانش، شکاف ها یا تصورات نادرست را در دانش آنها شناسایی کند.

بنابراین، ترکیب دانش ساختاریافته و قابل درک برای انسان می تواند تصمیم گیری مدل را با اجزای قابل توضیح تقویت کند. این باعث افزایش شفافیت و در عین حال افزایش قابلیت ها در برنامه های کاربردی دامنه خاص می شود.

هوش مصنوعی قابل توضیح

هدف تحقیق در زمینه هوش مصنوعی قابل توضیح (XAI) توسعه تکنیکهایی است که چگونگی رسیدن مدلهای پیچیده مانند LLM به خروجیها یا تصمیمات خاص را توصیف و تجسم میکند. رویکردهایی مانند نگاشت برجستگی و استخراج قانون کمک میکنند تا نتایج مدل ویژگیها به ویژگیهای ورودی و روابط آموختهشده بازگردد.

برای مثال، نگاشت برجسته تاثیرگذارترین کلمات ورودی را که منطق مدل خاصی را برای تولید متن فعال میکنند، برجسته میکند. این تکنیک می تواند نشان دهد که آیا همبستگی های نامناسب در طول آموزش آموخته شده است یا خیر.

در همین حال، استخراج قانون تلاش می کند تا الگوهای موجود در ارتباطات آماری مدل را به قوانین ساده IF-THEN تقطیر کند که کاربران بتوانند تفسیر کنند. این امر قوانین منصفانه تری را که مدل ممکن است به طور ضمنی از آن پیروی کند، استخراج می کند.

ابزارهای تجسم تعاملی نیز در حال ظهور هستند تا اشکالزدایی آسانتر حالتهای داخلی مدل را در پاسخ به ورودیهای آزمایشی امکانپذیر کنند. کاربران میتوانند ورودیها را تغییر دهند و تأثیرات منطق و خروجیهای پاییندستی را مشاهده کنند.

به طور کلی، تکنیکهای XAI میتوانند به طور موثر استدلال مدل را به روشهایی آشنا برای انسانها نشان دهند. اما چالشها در مقیاسبندی توضیحات در فضاهای پارامتر وسیع LLM باقی میماند. ادغام XAI در آموزش مدل ممکن است مدل هایی را به ارمغان بیاورد که ذاتاً توسط طراحی قابل توضیح هستند.

چارچوب LITE Box LLM

یکی از رویکردهایی که در موسسه مهندسی سریع برای ایجاد LLMهای قابل تفسیر بیشتر ایجاد کرده ایم، استفاده از یک چارچوب پردازش شفاف به نام جعبه شفافیت بینش زبانی (LITE) است.

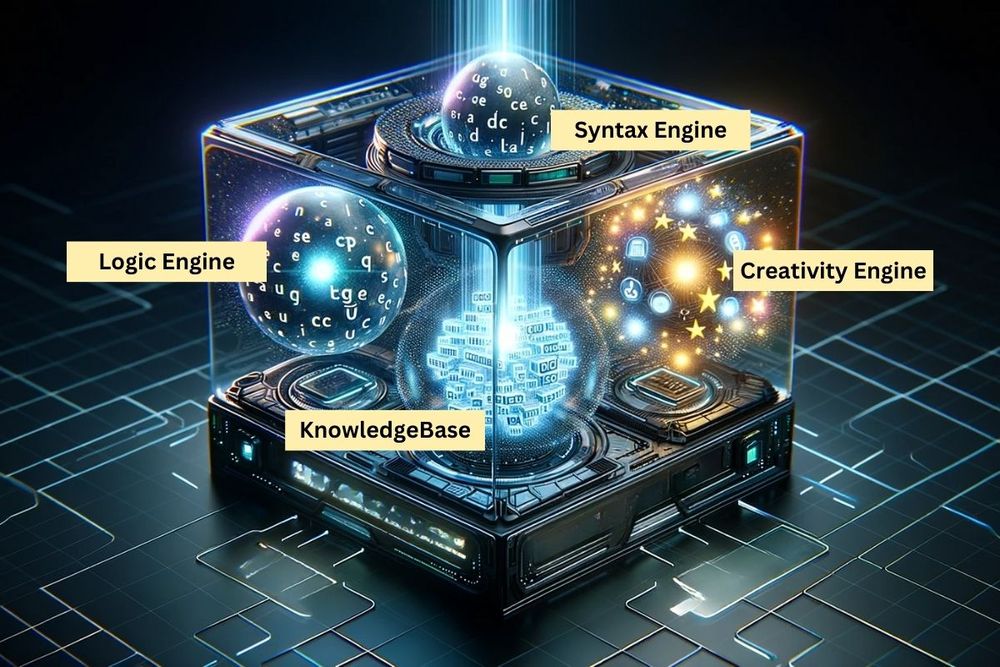

این LLM را به اجزای استدلال متمایز تقسیم می کند:

Syntax Engine : موتور Syntax تجزیه و تحلیل ساختاری و دستوری متن را انجام می دهد. بر روی کارهایی مانند تجزیه ورودی، تصحیح خطاها، سازماندهی بخش های منسجم و استخراج معنایی تمرکز می کند. این موتور یک پایه زبانی قوی برای عملیات LLM فراهم می کند.

موتور خلاقیت : این موتور جنبههای خلاقانه مانند ایدهپردازی، روایتنویسی و فرمولبندی سبک را هدایت میکند. از طریق تکنیک هایی مانند استعاره، زبان توصیفی و کاوش دیدگاه، استعداد و عمق می بخشد. موتور خلاقیت اصالت را به خروجی LLM تزریق می کند.

موتور منطقی : موتور منطقی زمینه و قصد ارزیابی ارتباط و دقت را تجزیه و تحلیل می کند. برای بررسی ادعاها، ارزیابی استدلال ها و اطمینان از قابلیت اطمینان واقعی، استدلال قیاسی را انجام می دهد. این امر ثبات منطقی را در نتیجه گیری های LLM ترویج می کند.

پایگاه دانش : پایگاه دانش حاوی حقایق و اطلاعات جهانی است که در طول آموزش جمع آوری شده است. موتور منطقی از این مخزن برای پایهگذاری پاسخهای LLM در شواهد تجربی استفاده میکند. جداسازی ذخیره سازی از پردازش به شفافیت کمک می کند.

چارچوب تفکیکشده LITE Box قابلیت تفسیرپذیری را در قوههای استدلال متمایز فراهم میکند. کاربران می توانند با تجزیه و تحلیل تعاملات بین این اجزای شفاف، رویکرد LLM را بهتر درک کنند. این دید دانه ای یک LLM واقعا قابل توضیح را امکان پذیر می کند.

طراحی شفاف LITE Box مشکلات تیرگی جعبه سیاه را کاهش می دهد. با جدا کردن پردازش زبان به ماژولهای قابل توضیح، کاربران میتوانند ایرادات را بهتر تشخیص دهند و عملکرد را به دقت تنظیم کنند. مهندسان سریع همچنین از درک چگونگی تعامل اجزای نحوی، منطقی و خلاق برای شکل دادن به خروجی سود می برند.

این دید امکان انتخاب معماری بهینه LLM را برای کارهای خاص فراهم می کند. همچنین به تحریک استراتژیک اجازه می دهد تا از موتورهای استدلال مختلف استفاده کند. فعال سازی هدفمند خلاقیت در مقابل ماژول های منطقی می تواند نتایج بهتری به همراه داشته باشد. به طور کلی، شفافیت دانهبندی LITE Box، شاهکارهای مهندسی سریعی را که با جعبه سیاه LLM یکپارچه امکانپذیر نیست، باز میکند.

چارچوب LITE Box یک جهت امیدوارکننده را برای فعال کردن LLM های قابل تفسیر نشان می دهد. من جزئیات بیشتری در مورد این معماری مدولار در مقاله آینده و جامع تر ارائه خواهم کرد. با ابهامزدایی از فرآیندهای داخلی، چنین چارچوبهای شفافی میتوانند LLMهای قابل توضیح و در عین حال توانمندی را که اعتماد کاربران را جلب میکنند، تحقق بخشند.