تا همین اواخر، بیشتر مدلهای هوش مصنوعی بر روی بهتر شدن در پردازش، تجزیه و تحلیل و تفسیر دادهها تمرکز داشتند. پیشرفتهای اخیر در مدلهای به اصطلاح شبکههای عصبی مولد، مجموعهای از ابزارهای جدید را برای ایجاد انواع محتوا، از عکسها و نقاشیها گرفته تا شعرها، کدها، فیلمنامهها و فیلمها به وجود آورده است.

مروری بر مدل های برتر تولید کننده هوش مصنوعی

محققان در اواسط دهه 2010 زمانی که رمزگذارهای خودکار متغیر (VAEs)، شبکههای متخاصم مولد (GAN) و مدلهای انتشار توسعه یافتند، نوید مدلهای هوش مصنوعی مولد جدید را کشف کردند. ترانسفورماتورها، شبکه عصبی پیشگامانه که می تواند مجموعه داده های بزرگ را در مقیاس تجزیه و تحلیل کند تا به طور خودکار مدل های زبانی بزرگ (LLM) ایجاد کند، در سال 2017 وارد صحنه شد. در سال 2020، محققان میدان های درخشندگی عصبی (NeRFs) را معرفی کردند، تکنیکی برای تولید محتوای سه بعدی از تصاویر دو بعدی

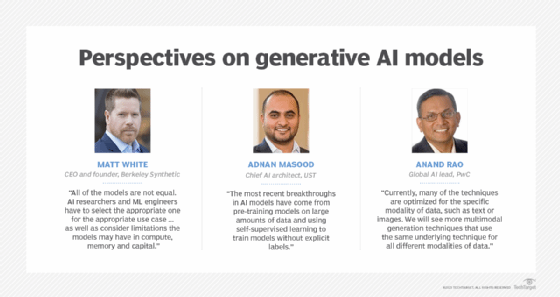

این مدلهای تولیدی که به سرعت در حال تکامل هستند، در حال پیشرفت هستند، زیرا محققان تغییراتی را انجام میدهند که اغلب منجر به پیشرفتهای بزرگ میشود. مت وایت، مدیر عامل و بنیانگذار برکلی سنتتیک، گفت و پیشرفت قابل توجه کند نشده است.

وایت، که همچنین در دانشگاه کالیفرنیا، برکلی تدریس میکند، میگوید: «معماریهای مدل دائماً در حال تغییر هستند و معماریهای مدل جدید همچنان توسعه خواهند یافت».

هر مدلی استعداد خاص خود را دارد. در حال حاضر، مدلهای انتشار در حوزه سنتز تصویر و ویدئو عملکرد فوقالعادهای دارند و ترانسفورماتورها در حوزه متن عملکرد خوبی دارند. GAN ها در تقویت مجموعه داده های کوچک با نمونه های مصنوعی قابل قبول خوب هستند. اما انتخاب بهترین مدل ها همیشه به موارد استفاده خاص بستگی دارد.

“همه مدل ها برابر نیستند. محققان هوش مصنوعی و ML [machine learning] وایت گفت: مهندسان باید مدل مناسب را برای موارد استفاده مناسب و عملکرد مورد نیاز انتخاب کنند، همچنین محدودیتهایی را که مدلها ممکن است در محاسبات، حافظه و سرمایه داشته باشند، در نظر بگیرند.

ترانسفورماتورها، به ویژه، بسیاری از پیشرفت های اخیر و هیجان در مورد مدل های مولد را هدایت کرده اند.

عدنان مسعود، معمار ارشد هوش مصنوعی در UST، یک مشاور تحول دیجیتال، میگوید: «جدیدترین پیشرفتها در مدلهای هوش مصنوعی از مدلهای پیشآموزشی بر روی مقادیر زیادی داده و استفاده از یادگیری خود نظارتی برای آموزش مدلهای بدون برچسبهای صریح به دست آمده است.

برای مثال، سری مدلهای Generative Pre-trained Transformer OpenAI یکی از بزرگترین و قدرتمندترینها در این دسته هستند که یکی از آخرین مدلها، GPT-3، حاوی 175 میلیارد پارامتر است.

کاربردهای کلیدی برترین مدل های هوش مصنوعی مولد

مسعود توضیح داد که مدل های برتر هوش مصنوعی مولد از تکنیک ها و رویکردهای مختلفی برای تولید داده های جدید استفاده می کنند. ویژگی ها و کاربردهای کلیدی شامل موارد زیر است:

- VAEها از معماری رمزگذار-رمزگشا برای تولید دادههای جدید، معمولاً برای تولید تصویر و ویدیو، مانند تولید چهرههای مصنوعی برای حفاظت از حریم خصوصی، استفاده میکنند.

- GAN ها از یک مولد و تشخیص دهنده برای تولید داده های جدید استفاده می کنند و اغلب در توسعه بازی های ویدیویی برای ایجاد شخصیت های واقعی بازی استفاده می شوند.

- مدلهای Diffusion برای تولید تصاویر باکیفیت با جزئیات بالا، نویز را اضافه و سپس حذف میکنند و تصاویری تقریبا واقعی از صحنههای طبیعی ایجاد میکنند.

- ترانسفورماتورها به طور موثر داده های متوالی را برای ترجمه ماشینی، خلاصه سازی متن و ایجاد تصویر به صورت موازی پردازش می کنند.

- NeRF ها یک رویکرد جدید برای بازسازی صحنه سه بعدی ارائه می دهند که از نمایش عصبی استفاده می کند.

بیایید هر رویکرد را با جزئیات بیشتری بررسی کنیم.

VAEs

VAE ها در سال 2014 برای رمزگذاری داده ها با استفاده از یک شبکه عصبی به صورت کارآمدتر توسعه یافتند.

Yael Lev، رئیس هوش مصنوعی برای Sisense، یک پلت فرم تجزیه و تحلیل هوش مصنوعی، گفت VAE ها یاد می گیرند که اطلاعات را به طور کارآمدتر نشان دهند. آنها دو بخش دارند: یک رمزگذار که داده ها را کوچکتر می کند و یک رمزگشا که آنها را به شکل اصلی خود باز می گرداند. آنها در ساختن نمونه های جدید از اطلاعات کوچکتر، رفع تصاویر یا داده های پر سر و صدا، یافتن چیزهای غیرعادی در داده ها و پر کردن اطلاعات از دست رفته ایده آل هستند.

مسعود از UST گفت، با این حال، VAE ها نیز تمایل به تولید تصاویر تار یا با کیفیت پایین دارند. مسئله دیگر این است که فضای پنهان، فضایی با ابعاد کم برای گرفتن ساختار داده ها، پیچیده و چالش برانگیز است. این ضعفها میتوانند اثربخشی VAE را در برنامههایی که تصاویر با کیفیت بالا یا درک واضح فضای نهفته ضروری است، محدود کند. تکرار بعدی VAE ها احتمالاً بر بهبود کیفیت داده های تولید شده، افزایش سرعت آموزش و بررسی قابلیت کاربرد آنها در داده های متوالی تمرکز خواهد کرد.

GAN ها

GAN ها در سال 2014 برای تولید چهره های واقعی و اعداد چاپ شده توسعه یافتند. GAN ها یک شبکه عصبی تولید کننده را که محتوای واقعی ایجاد می کند در مقابل یک شبکه عصبی متمایز برای تشخیص محتوای جعلی قرار می دهند. آناند رائو، رهبر جهانی هوش مصنوعی در PwC میگوید: «به طور مکرر، این دو شبکه با هم همگرا میشوند تا تصویری تولید شده تولید کنند که از دادههای اصلی قابل تشخیص نیست.

GAN ها معمولا برای تولید تصویر، ویرایش تصویر، وضوح فوق العاده، تقویت داده ها، انتقال سبک، تولید موسیقی و ایجاد دیپ فیک استفاده می شوند.

یکی از مشکلات GAN ها این است که آنها می توانند از فروپاشی حالت رنج ببرند که در آن ژنراتور خروجی های محدود و تکراری تولید می کند و آموزش آنها را دشوار می کند. مسعود گفت که نسل بعدی GAN ها بر بهبود ثبات و همگرایی فرآیند آموزش، گسترش کاربرد آنها در سایر حوزه ها و توسعه معیارهای ارزیابی کارآمدتر تمرکز خواهند کرد.

Lev مشاهده کرد که بهینه سازی و تثبیت GAN ها نیز سخت است و هیچ کنترل صریحی بر روی نمونه های تولید شده وجود ندارد.

انتشار

مدلهای انتشار توسط تیمی از محققان استنفورد در سال 2015 برای مدلسازی و معکوس کردن آنتروپی و نویز توسعه داده شد. اصطلاحات انتشار پایدار و انتشار گاهی به جای هم استفاده می شوند زیرا برنامه انتشار پایدار – که در سال 2022 منتشر شد – به جلب توجه به تکنیک قدیمی تر انتشار کمک کرد. تکنیکهای انتشار راهی برای مدلسازی پدیدهها، مانند نحوه انتشار مادهای مانند نمک به مایع، و سپس معکوس کردن آن ارائه میکنند. همین مدل برای تولید محتوای جدید از یک تصویر خالی نیز مفید است.

وایت گفت که مدلهای دیفیوژن روش فعلی برای تولید تصویر هستند. آنها مدل پایه خدمات تولید تصویر محبوب مانند Dall-E 2، Stable Diffusion، Midjourney و Imagen هستند. آنها همچنین در خطوط لوله برای تولید صدا، ویدئو و محتوای سه بعدی استفاده می شوند. علاوه بر این، روش انتشار همچنین می تواند برای انتساب داده ها استفاده شود، جایی که داده های گمشده پیش بینی و تولید می شوند.

بسیاری از برنامه ها مدل های انتشار را با یک LLM برای تولید متن به تصویر یا متن به ویدئو جفت می کنند. به عنوان مثال، Stable Diffusion 2 از a استفاده می کند پیش آموزش زبان متضاد-تصویر مدل به عنوان رمزگذار متن همچنین مدل هایی برای عمق و افزایش مقیاس اضافه می کند.

مسعود پیشبینی کرد که پیشرفتهای بیشتر در مدلهایی مانند Stable Diffusion ممکن است بر بهبود پیامهای منفی تمرکز کند، توانایی تولید تصاویر به سبک هنرمندان خاص و بهبود تصاویر افراد مشهور را افزایش دهد.

مبدل ها

Transformers در سال 2017 توسط تیمی در Google Brain برای بهبود ترجمه زبان توسعه داده شد. آنها برای پردازش اطلاعات با ترتیبی متفاوت نسبت به دادهها، پردازش دادهها به صورت موازی و مقیاسبندی تا مدلهای بزرگ با استفاده از دادههای بدون برچسب مناسب هستند.

وایت گفت که میتوان از آنها برای خلاصهسازی متن، رباتهای گفتگو، موتورهای توصیه، ترجمه زبان، پایگاههای دانش، شخصیسازی بیش از حد (از طریق مدلهای ترجیحی)، تجزیه و تحلیل احساسات، و شناسایی نهادهای نامگذاری شده برای شناسایی افراد، مکانها و چیزها استفاده کرد. همچنین میتوان از آنها برای تشخیص گفتار مانند Whisper OpenAI، تشخیص اشیا در فیلمها و تصاویر، نوشتن شرح تصاویر، فعالیتهای طبقهبندی متن و تولید گفتگو استفاده کرد.

با وجود تطبیق پذیری آنها، ترانسفورماتورها محدودیت هایی دارند. آموزش آنها ممکن است گران باشد و به مجموعه داده های بزرگی نیاز داشته باشد.

مدلهای بهدستآمده نیز بسیار بزرگ هستند، که شناسایی منبع سوگیری یا نتایج نادرست را به چالش میکشد. مسعود گفت: “پیچیدگی آنها همچنین می تواند تفسیر کارکردهای درونی آنها را دشوار کند و مانع از توضیح و شفافیت آنها شود.”

NeRFs

NeRF ها در سال 2020 برای ثبت تصاویر سه بعدی از میدان های نوری در یک شبکه عصبی ساخته شدند. اجرای اول بسیار کند بود و چندین روز طول کشید تا اولین تصاویر سه بعدی ثبت شود.

با این حال، در سال 2022، محققان Nvidia راهی برای تولید یک مدل جدید در حدود 30 ثانیه پیدا کردند. این مدلها میتوانند اشیاء سهبعدی – با کیفیت قابل مقایسه – را در چند مگابایت نشان دهند که با تکنیکهای دیگر میتوانند گیگابایت ببرند. این امید وجود دارد که آنها بتوانند به تکنیک های کارآمدتری برای گرفتن و تولید اشیاء سه بعدی در متاوره منجر شوند. الکساندر کلر، مدیر تحقیقات انویدیا به تایم گفت که NeRF ها “در نهایت می توانند برای گرافیک سه بعدی به اندازه دوربین های دیجیتال برای عکاسی مدرن مهم باشند.”

مسعود گفت NeRF ها همچنین پتانسیل زیادی برای روباتیک، نقشه برداری شهری، ناوبری مستقل و کاربردهای واقعیت مجازی نشان داده اند.

با این حال، NERF ها هنوز از نظر محاسباتی گران هستند. همچنین ایجاد چندین NERF در صحنه های بزرگتر چالش برانگیز است. وایت هشدار داد که امروزه تنها مورد قابل استفاده NeRF ها تبدیل تصاویر به اشیا یا صحنه های سه بعدی است.

علیرغم این محدودیتها، مسعود پیشبینی کرد که NeRFها نقشهای جدیدی در وظایف اصلی پردازش تصویر، مانند حذف نویز، رفع تاری، نمونهبرداری، فشردهسازی و ویرایش تصویر پیدا خواهند کرد.

اکوسیستم GenAI، کاری در حال انجام است

توجه به این نکته ضروری است که این مدل ها در حال پیشرفت هستند. محققان به دنبال بهبود مدل های فردی و روش های ترکیب آنها با سایر مدل ها و تکنیک های پردازش هستند.

Lev پیشبینی کرد که مدلهای مولد همهکارهتر خواهند شد و برنامههای کاربردی فراتر از حوزههای سنتی خود گسترش خواهند یافت. کاربران همچنین میتوانند مدلهای هوش مصنوعی را به طور مؤثرتری راهنمایی کنند و بفهمند که چگونه بهتر کار میکنند.

رائو گفت، علاوه بر این، هر تکنیک در پشتیبانی از انواع داده های اضافی بهتر می شود.

او گفت: «در حال حاضر، بسیاری از تکنیکها برای روشهای خاص دادهها، مانند متن یا تصویر، بهینهسازی شدهاند. ما تکنیکهای تولید چندوجهی بیشتری را خواهیم دید که از تکنیک زیربنایی یکسانی برای همه روشهای مختلف داده استفاده میکنند.»

وایت خاطرنشان کرد که کار روی مدلهای چندوجهی نیز در حال انجام است که از روشهای بازیابی برای فراخوانی کتابخانهای از مدلهای بهینهسازی شده برای کارهای خاص استفاده میکنند. او همچنین انتظار دارد که مدلهای مولد قابلیتهای دیگری مانند برقراری تماسهای API و استفاده از ابزارهای خارجی را توسعه دهند. به عنوان مثال، یک LLM که بر روی دانش مرکز تماس یک شرکت تنظیم شده است، به سؤالات پاسخ می دهد و عیب یابی را انجام می دهد، مانند تنظیم مجدد مودم مشتری یا ارسال ایمیل پس از رفع مشکل.

در واقع، معماری های مدل محبوب امروزی ممکن است در نهایت با چیزی کارآمدتر در آینده جایگزین شوند. وایت گفت: «شاید ترانسفورماتورها و مدلهای انتشار بیشتر از زمانی که معماریهای جدید به وجود میآیند، مفید باشند. ما این را در مورد ترانسفورماتورها زمانی دیدیم که معرفی آنها الگوریتمهای حافظه کوتاهمدت و RNN را ایجاد کرد [recurrent neural networks] روش های کمتر مطلوب برای کاربردهای زبان طبیعی.”

رائو همچنین پیشبینی کرد که اکوسیستم هوش مصنوعی مولد به سه لایه مدل تبدیل خواهد شد. لایه پایه مجموعه ای از مدل های بنیادی مبتنی بر متن، تصویر، صدا و کد است. این مدلها حجم زیادی از دادهها را دریافت میکنند، بر اساس مدلهای یادگیری عمیق بزرگ ساخته شدهاند و قضاوت انسان را در بر میگیرند.

در مرحله بعد، مدل های دامنه خاص صنعت و عملکرد، پردازش مراقبت های بهداشتی، حقوقی یا انواع دیگر داده ها را بهبود می بخشد.

در سطح بالا، شرکت ها از داده های اختصاصی و تخصص موضوعی خود برای ساخت مدل های اختصاصی استفاده خواهند کرد. این سه لایه نحوه توسعه مدلها توسط تیمها را مختل میکند و دوره جدیدی از مدل را به عنوان یک سرویس آغاز میکند.

نحوه انتخاب یک مدل هوش مصنوعی مولد: ملاحظات برتر

با توجه به Sisense’s Lev، ملاحظات اصلی هنگام انتخاب از بین مدل ها شامل موارد زیر است:

- مشکلی که می خواهید حل کنید. مدلی را انتخاب کنید که برای کار خاص شما به خوبی کار می کند. به عنوان مثال، از ترانسفورماتور برای وظایف زبان و NeRF برای صحنه های سه بعدی استفاده کنید.

- مقدار و کیفیت داده های شما. ترانسفورماتورها برای کارکرد خوب به داده های خوب زیادی نیاز دارند، در حالی که VAE ها با داده های کمتر بهتر کار می کنند.

- کیفیت نتایج. GAN ها برای تصاویر واضح و دقیق بهتر هستند، در حالی که VAE ها برای نتایج صاف تر بهتر هستند.

- آموزش مدل چقدر آسان است. آموزش GAN ها می تواند دشوار باشد، در حالی که VAE و ترانسفورماتور آسان تر هستند.

- منابع محاسباتی NeRF ها و ترانسفورماتورهای بزرگ هر دو برای کارکرد خوب نیاز به نیروی کامپیوتر زیادی دارند.

- نیاز به کنترل و درک. اگر بخواهید کنترل بیشتری روی نتایج داشته باشید یا درک بهتری از نحوه عملکرد مدل داشته باشید، VAE ممکن است بهتر از GAN باشد.