شبکه های متخاصم مولد نوید قابل توجهی برای تولید رسانه هایی مانند تصاویر و صداها و همچنین مولکول های دارو دارند. آنها همچنین یکی از محبوب ترین تکنیک های هوش مصنوعی مولد بودند تا اینکه چند سال پیش ترانسفورماتورها معرفی شدند.

ترانسفورماتورها یک فناوری اساسی هستند که زیربنای بسیاری از پیشرفتها در مدلهای زبان بزرگ، مانند ترانسفورماتورهای از پیش آموزشدیده (GPT) هستند. آنها اکنون در حال گسترش به برنامههای هوش مصنوعی چندوجهی هستند که میتوانند محتوای متنوعی مانند متن، تصاویر، دستورالعملهای صوتی و ربات را در انواع رسانههای مختلف با کارآمدتری نسبت به تکنیکهایی مانند GAN مرتبط کنند.

بیایید شروع هر تکنیک، موارد استفاده از آنها و اینکه چگونه محققان اکنون این دو تکنیک را در ترکیب های مختلف ترانسفورماتور-GAN ترکیب می کنند را بررسی کنیم.

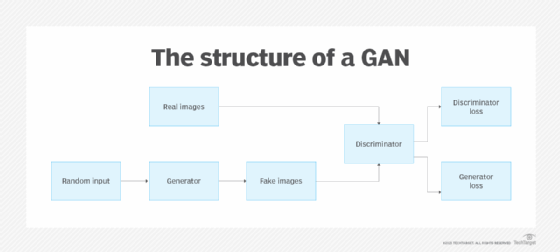

معماری GAN توضیح داد

GAN ها در سال 2014 توسط Ian Goodfellow و همکارانش معرفی شدند تا اعداد و چهره هایی با ظاهر واقعی ایجاد کنند. آنها دو شبکه عصبی زیر را ترکیب می کنند:

- یک مولد، که معمولاً یک شبکه عصبی کانولوشن (CNN) است که محتوا را بر اساس پیام متن یا تصویر ایجاد می کند.

- یک تمایز، معمولاً یک شبکه عصبی دکانولوشنال که تصاویر معتبر و تقلبی را شناسایی میکند.

قبل از GAN ها، بینایی کامپیوتری بود عمدتا انجام می شود آدریان زیداریتز، بنیانگذار مؤسسه دموکراسی قوی تر از طریق هوش مصنوعی، گفت: با CNN هایی که ویژگی های سطح پایین تر یک تصویر، مانند لبه ها و رنگ، و ویژگی های سطح بالاتری که کل اشیاء را نشان می دهند، ثبت می کنند. تازگی معماری GAN ناشی از رویکرد خصمانه آن است که در آن یک شبکه عصبی تصاویر تولید شده را پیشنهاد میکند، در حالی که شبکه عصبی آنها را وتو میکند اگر به تصاویر معتبر از مجموعه دادهای معین نزدیک نشوند.

نمودار یک شبکه متخاصم مولد

امروزه محققان در حال بررسی راه هایی برای استفاده از مدل های دیگر شبکه های عصبی از جمله ترانسفورماتور هستند.

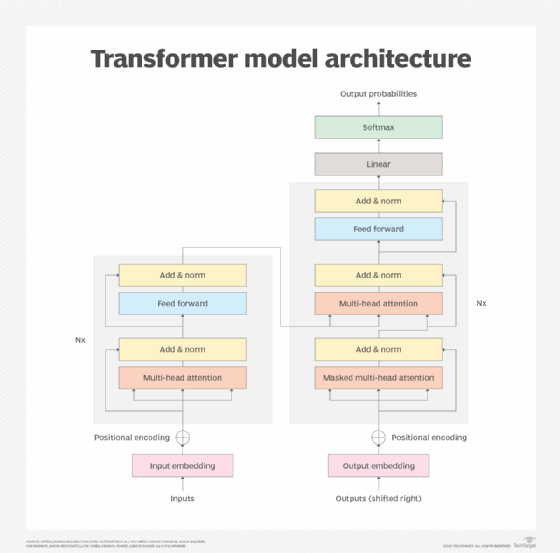

معماری ترانسفورماتور توضیح داد

Transformers توسط تیمی از محققان گوگل در سال 2017 معرفی شدند که به دنبال ساخت مترجمی کارآمدتر بودند. در یک کاغذ محققان با عنوان “توجه تنها چیزی است که شما نیاز دارید”، روش جدیدی را برای تشخیص معنای کلمات بر اساس نحوه توصیف کلمات دیگر در عبارات، جملات و مقالات ارائه کردند.

ابزارهای قبلی برای تفسیر متن اغلب از یک شبکه عصبی برای ترجمه کلمات به بردار با استفاده از فرهنگ لغت ساخته شده قبلی و شبکه عصبی دیگری برای پردازش دنباله ای از متن استفاده می کردند، مانند یک شبکه عصبی تکراری (RNN). در مقابل، ترانسفورماتورها اساساً یاد می گیرند که معنای کلمات را مستقیماً از پردازش متن های بزرگ بدون برچسب تفسیر کنند. همین رویکرد همچنین میتواند برای شناسایی الگوها در انواع دیگر دادهها، مانند توالیهای پروتئین، ساختارهای شیمیایی، کدهای کامپیوتری و جریانهای دادههای اینترنت اشیا استفاده شود. این به محققان اجازه میدهد تا مدلهای زبان بزرگ را که باعث پیشرفتهای اخیر – و تبلیغات – در این زمینه میشوند، مقیاسبندی کنند. ترانسفورماتورها همچنین می توانند روابط بین کلماتی را پیدا کنند که از هم دور هستند، که برای RNN ها غیرعملی بود.

نموداری که معماری یک مدل ترانسفورماتور را نشان می دهد.

زیداریتز گفت که تکههای کوچک یک تصویر را میتوان با زمینههای کل تصاویری که در آن ظاهر میشوند نیز تعریف کرد. را اندیشه توجه به خود در پردازش زبان طبیعی (NLP) تبدیل می شود خود شباهت در بینایی کامپیوتری

GAN در مقابل ترانسفورماتور: بهترین موارد استفاده برای هر مدل

به گفته ریچارد سرل، معاون محاسبات محرمانه در Fortanix، یک پلت فرم امنیت داده، GAN ها در طیف بالقوه برنامه های کاربردی خود انعطاف پذیرتر هستند. آنها همچنین در مواردی مفید هستند که داده های نامتعادل، مانند تعداد کمی موارد مثبت در مقایسه با حجم نمونه های منفی، می تواند منجر به طبقه بندی های مثبت کاذب متعدد شود. در نتیجه، یادگیری خصمانه در موارد استفاده که دادههای آموزشی محدودی برای وظایف تبعیضآمیز وجود دارد یا در کشف تقلب که در آن تنها تعداد کمی از تراکنشها ممکن است در مقایسه با تراکنشهای رایجتر، تقلب را نشان دهند، نویدبخش است. به عنوان مثال، در یک سناریوی تقلب، هکرها دائما ورودی های جدیدی را برای فریب دادن الگوریتم های تشخیص تقلب معرفی می کنند. GAN ها در سازگاری و محافظت در برابر این نوع تکنیک ها بهتر عمل می کنند.

سرل گفت، ترانسفورماتورها معمولاً در جایی استفاده میشوند که روابط ورودی-خروجی متوالی باید مشتق شوند، و تعداد ترکیبهای ممکن از ویژگیها نیازمند توجه متمرکز برای ارائه زمینه محلی است. به همین دلیل، ترانسفورماتورها در برنامه های NLP برتری یافته اند، زیرا می توانند محتوایی با هر طولی مانند عبارات یا اسناد کامل را پردازش کنند. ترانسفورماتورها همچنین در پیشنهاد حرکت بعدی در برنامه هایی مانند بازی، که در آن مجموعه ای از پاسخ های بالقوه باید با توجه به دنباله شرطی ورودی ها ارزیابی شوند، خوب هستند.

همچنین تحقیقات فعالی در مورد ترکیب GAN ها و ترانسفورماتورها وجود دارد باصطلاح GANsformers. ایده این است که از یک ترانسفورماتور برای ارائه یک مرجع توجه استفاده شود تا مولد بتواند استفاده از زمینه را برای افزایش محتوا افزایش دهد.

سرل توضیح داد: “شهود پشت GANsformers این است که توجه انسان بر ویژگی های محلی خاص یک شی مورد علاقه، علاوه بر ویژگی های نهفته جهانی است.” نمایش های بهبود یافته به احتمال زیاد هر دو ویژگی های جهانی و محلی را که یک انسان ممکن است در یک نمونه معتبر درک کند، شبیه سازی می کند، مانند یک چهره واقعی یا صدای تولید شده توسط کامپیوتر که با لحن و ریتم صدای انسان سازگار است.

آیا شبکه های مبتنی بر ترانسفورماتور قوی تر از GAN ها هستند؟

ترانسفورماتورها به لطف نقش خود در ابزارهای محبوبی مانند ChatGPT و پشتیبانی از هوش مصنوعی چندوجهی در حال رشد هستند. اما ترانسفورماتورها لزوماً جایگزین GAN ها برای همه برنامه ها نمی شوند.

سرل انتظار دارد شاهد ادغام بیشتر برای ایجاد داده های متن، صدا و تصویر با واقع گرایی پیشرفته باشد. او گفت: «این ممکن است در جایی مطلوب باشد که رئالیسم متنی یا روانی در تعامل انسان و ماشین یا محتوای دیجیتال تجربه کاربر را افزایش دهد.» به عنوان مثال، GANsformers ممکن است قادر به تولید داده های مصنوعی برای گذراندن آزمون تورینگ در صورت مواجهه با یک کاربر انسانی و یک ارزیاب ماشین آموزش دیده باشد. در مورد پاسخهای متنی، مانند پاسخهایی که توسط یک سیستم GPT ارائه میشود، گنجاندن خطاهای خاص یا ویژگیهای سبکی میتواند منشأ واقعی خروجی مشتقشده از هوش مصنوعی را بپوشاند.

برعکس، بهبود واقع گرایی ممکن است با دیپ فیک هایی که برای حمله سایبری، آسیب رساندن به برندها یا انتشار اخبار جعلی استفاده می شوند، مشکل ساز باشد. در این موارد، GANsformers میتواند فیلترهای بهتری برای تشخیص دیپفیک ارائه کند.

سرل گفت: «استفاده از آموزشهای خصمانه و ارزیابی زمینهای میتواند سیستمهای هوش مصنوعی را ایجاد کند که قادر به ارائه امنیت پیشرفته، فیلتر کردن محتوا و دفاع در برابر حملات اطلاعات نادرست با استفاده از باتنتهای مولد هستند.

اما زیداریتز معتقد است که ترانسفورماتورها به طور بالقوه می توانند GAN ها را در بسیاری از موارد استفاده کنند، زیرا می توانند به راحتی روی متن و تصاویر اعمال شوند. او گفت: “GAN های جدید به توسعه ادامه خواهند داد، اما کاربرد آنها محدودتر از GPT ها خواهد بود.” همچنین به احتمال زیاد ترانسفورماتورهای GAN مانند و GANهای ترانسفورماتور مانند بیشتری را مشاهده خواهیم کرد که در هر دوی آنها ترانسفورماتور با توجه به خود یا مکانیسم خود شباهت خود مرکزی خواهد بود.